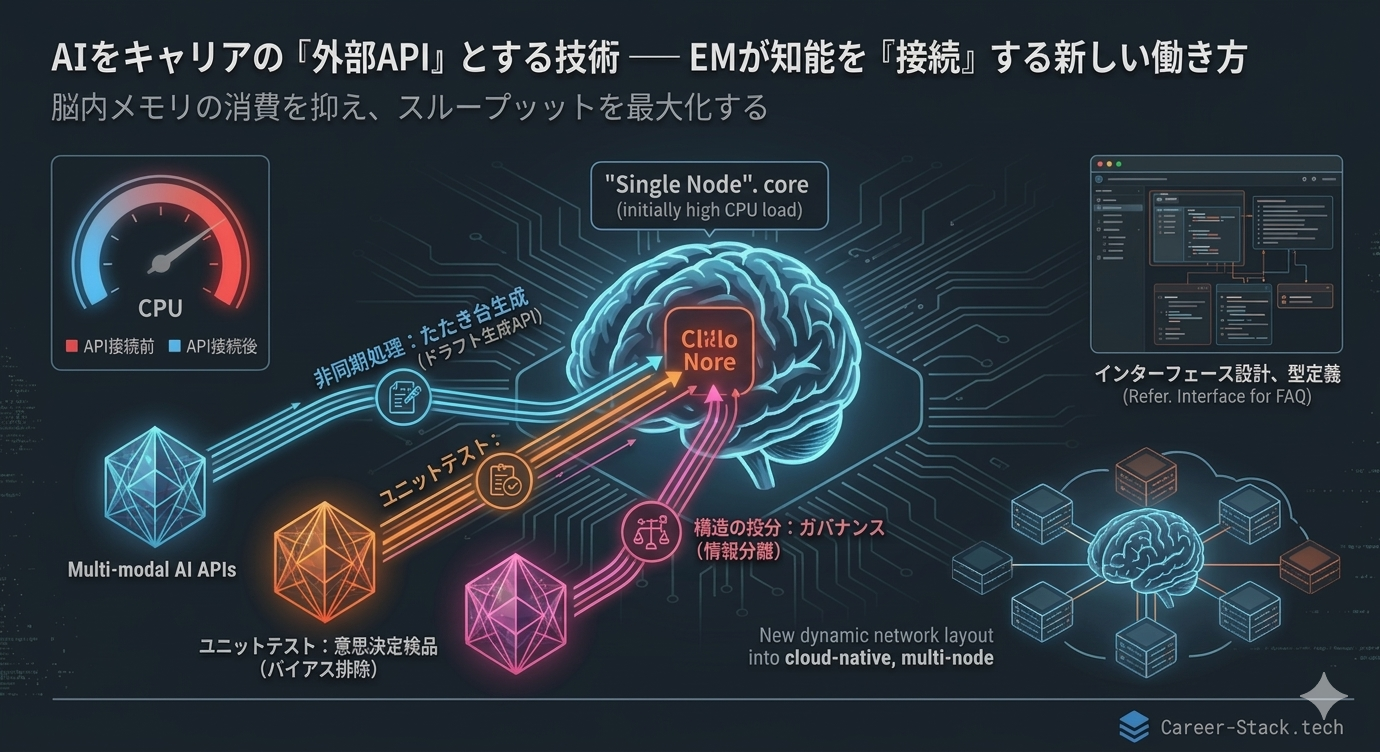

脳内メモリの消費を抑え、スループットを最大化する

「生成AIを導入したが、プロンプトを考える時間が無駄に感じられる」 「AIの回答を修正する工数がかさみ、結局自分で書いた方が早い」

こうしたエラー報告の主因は、AIを「部下(人間)」の代替として扱おうとするモデル設計のミスにある。ハイクラスなEMにとって、AIは「育成対象」ではなく、特定の入力を与えれば即座に期待値を返す「外部API」であるべきだ。

知能を自分の脳内に「所有」する時代は終わった。これからは、いかに効率よく外部の知能に「接続」し、自分というメインスレッドの占有率(CPU Usage)を下げるか。AIを外部APIとして使う技術は、以下の3つの実装レイヤーで成立する。

1. 非同期処理としての「たたき台生成」

EMの業務において最もコストが高いのは、「ゼロから1を作る」起呼プロセスだ。週報、ドキュメントの構成、施策の骨子。これらを自分の脳内でシリアライズする必要はない。

AIを「ドラフト生成API」として非同期に叩く。自分は「意図(Intent)」と「制約条件(Constraints)」をパケットとして投げるだけでいい。戻り値が60点の精度であっても、それをリファクタリングするコストは、ゼロから書くコストの20%以下に抑えられる。

この「依頼コストの極小化」については、

→

AI PM 2.0:GeminiとGPTを「競合」させて品質を担保する相互監視プロトコル(近日公開予定)

で詳述するマルチLLMによる品質担保プロトコルへと繋がっていく。

2. 意思決定の「ユニットテスト」としてのAI活用

マネジメントにおける意思決定は、常にバイアスという名のバグを孕んでいる。自分の判断が論理的に妥当か、あるいは組織政治に流されていないか。これを検証するために、AIを「テストランナー」として利用する。

- 「この意思決定の論理的欠陥を3つ指摘せよ」

- 「反対派のステークホルダーが主張しそうな反論をシミュレーションせよ」

このようにAIを「批判的外部モジュール」として接続することで、実戦投入(本番デプロイ)前に意思決定の堅牢性を高めることができる。

で提唱する、ストック型システムへの転換において不可欠な「検品工程」である。

3. 情報ガバナンスと「構造の按分」

AIを外部APIとして活用する際、最も注意すべきはセキュリティと機密情報のハンドリングだ。全ての情報をAPIに投げるのは「全件漏洩」のリスクを孕む。重要なのは、情報を「構造」と「具体」に分離し、構造のみをAIに解釈させる技術である。

この「構造による統治」は、

で解説する、組織を蝕む属人性を排除するための「9.9%の論理」と密接に関係している。

FAQ:AI API実装における「実行時エラー」

- Q:プロンプトエンジニアリングを学ぶべきですか?

- A:否。手法に固執するのは実装のオーバーヘッドだ。重要なのは「何を出力させたいか」という入出力の型定義(インターフェース設計)であり、言語化能力そのものである。

- Q:AIに依存しすぎて、自分のスキルが退化しませんか?

- A:逆だ。AIというAPIを使いこなすことで、あなたは「コードを書く作業員」から「システムを構築するアーキテクト」へと昇華する。退化するのは「単純作業の慣れ」であり、進化するのは「設計能力」である。

Next Stack(思想を深める)

Continue Reading(次の記事へ)

Related Stack(関連する思想)

Back to Structural Hub(思想の中枢へ戻る)

おわりに:自分の「脳」をスケーリングせよ

AIを外部APIとして統合することは、自分の知能をクラウドネイティブな環境へとリプレースすることに等しい。

「自分一人で考える」というシングルノードの限界を突破し、無限にスケールする外部知能と同期する。この接続術(コネクティビティ)こそが、EMの思考スループットを最大化する新しいテクニカルスタックである。

コメント